-

>

ȫ��Ӌ��C�ȼ���ԇ�����濼�}��ģ�M������Ԕ�⡤����MSOffice������

-

>

�Q���Мy5000�}(���Z�����c���_)

-

>

ܛ�����ܜyԇ.�����c�{�����`֮·

-

>

��һ�д��aAndroid

-

>

JAVA���m����

-

>

EXCEL��̿ƕ�(��ȫ��)(ȫ��ӡˢ)

-

>

��ȌW��

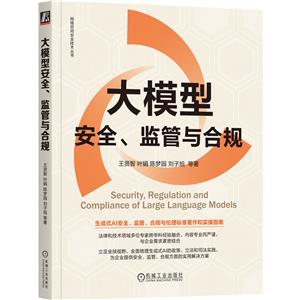

��ģ�Ͱ�ȫ���O���c��Ҏ �����Ϣ

- ISBN��9787111763239

- �l�δa��9787111763239 ; 978-7-111-76323-9

- �b����ƽ�b-�zӆ

- �Ԕ������o

- ���������o

- ���ٷ��>

��ģ�Ͱ�ȫ���O���c��Ҏ ������ɫ

��1���˜������������Lԇ��10�����������ʽAI�İ�ȫ���O�ܡ���Ҏ�����톖�}�ṩ��Q������������ԓ�I��Ę˜ʅ�����������2�����I��֔�������ɶ�λ���Է��ɡ����g�ͽ����I��Č��ҵĿ�W�ƽ�����Y���ɣ��_���˃��ݵČ��I�Ժ͇�֔�ԡ���3��ȫ��ҕҰ������������ȫ����Ҫ���Һ͵^������ʽAI�I��ıO�ܡ�������˾�����`�������S���������茍����4������ָ�ϣ���������ȫ�溭�w����ʽAI���R�ĺ�Ҏ�c��ȫ���}���Ć��}�������������ԣ��ṩ����ָ����

��ģ�Ͱ�ȫ���O���c��Ҏ ���ݺ���

���ݺ��� �@��һ���ļ��g��ȫ���O�ܿ�ܡ���ҎҪ�������µȽǶ�ȫ���v������ʽ�˹����ܰ�ȫ���}�Č����������������ڈԌ�����Փ���A֮�ϣ�ͨ�^�S���İ������茍�Ĕ�����ϵ�y��������I����������ʽ�˹����܌��`�����R�ĸ��N��ȫ���𣬲��o���ˑ������ԡ�������Ŀ���Ǟ��x���ṩȫ���Ҍ��õ��Єӿ�ܺ͌���ָ�ϣ��Դ��M����ʽ�˹������ИI�Ľ����lչ�� �����ں��˿�W�ƌ��ҵļ��g�ͽ����߈F꠰�����ȫ�I����Y��g��Ӣ��ܛ���½������ң�MIEE��������ʽ�˹����ܼ��g���ң��Լ��ڴ���I�����ɽ���������֪�R�a���c������Ҏ����Č��ҡ������{����ԵČ��I֪�R�͌��`������Փ�c���վo�ܽY�ϣ����x���ṩ�ˌ��F��Ҋ��ͅ����� ��x�����ձ������㌢�ի@����10������֪�R�� ��1����ģ�Ͱ�ȫ�ķ������F������𣺰�����ȫ���O���c��Ҏ���P�I���}���Լ����Ұ�ȫ����������ǶȰ�ȫ�[�����L�U�c�� ��2����ģ�ͼ��g����İ�ȫ�L�U��������Ϣ��ȫԭ�t�����y��ȫ�L�U���R�e�ͷ��������D�������Լ���ģ�͵Ĺ��д����ԡ� ��3����ģ�ͱO���c��Ҏ�ķ��ɿ�ܣ�����ȫ���ȵ�AIGC�ıO�ܬF����V�A�������̷��{��������Mչ���Լ����ȱO���wϵ�͇�����ͷ���ıO�܌��`�� ��4����ģ��֪�R�a���Ҏ���ڴ�ģ�͵��_�l�͑����У���δ_��֪�R�a��ĺ�Ҏ�ԣ����������ࡢ�_Դ�f�h�������ࡢ�̘˙���̘I���ܵı��o�� ��5����ģ�͔�����Ҏ���ڴ�ģ�͵Ę����^������δ_��������Ҏ������ģ��Ӗ�������ú̓�����ȫ���̵Ĕ�����Ҏ�� ��6����ģ�̓��ݰ�ȫ���ڴ�ģ�͵đ����^������δ_�����ݰ�ȫ���������ݱO�ܡ����ݰ�ȫ�L�U�̓��ݰ�ȫ��Ҏ�� ��7����ģ���㷨��Ҏ���ڴ�ģ�͵Ę����͑����_�l�^������δ_���㷨��Ҏ�������㷨�䰸���˹����ܰ�ȫ�u�����㷨���_�����㷨���Ƀ��ݘ��R���㷨����ҕ���c�㷨���P���֙���㷨��ҎҪ�c���Y�� ��8����ģ�͂�����ȫ���ڴ�ģ�͵Ę����͑����^������δ_��������ȫ�����������L�U��������������팍�`���������Ժ��Բ鹤�߱��� ��9����ģ�͵İ�ȫ���Ϸ�������Θ���һ���Ȱ�ȫ�ֿ��ŵĴ�ģ�ͭh�����������y���g����İ�ȫ���ϡ���������ı��ϲ��ԺͿ��Ō��ԽǶȵİ�ȫ���o���ԡ� ��10������ʽ�˹����ܵİlչڅ�ݣ��ļ��gҕ�Ǻͷ���ҕ�ǣ������ģ���ڰ�ȫ���O���c��Ҏ����İlչڅ�ݡ�

��ģ�Ͱ�ȫ���O���c��Ҏ Ŀ�

��1�¡����Z��ģ�Ͱ�ȫ��������1

1.1�����Z��ģ�͵İlչ�vʷ�c���g�F��2

1.1.1�����£���Դ�c�����ΑB2

1.1.2���D�ۣ��W�j���d��2

1.1.3���F�����ˣ�GPT�cBERT�ĕr��3

1.1.4�����g�F���c�����I��4

1.2�����Z��ģ�Ͱ�ȫ�ķ���5

1.2.1�����Z��ģ�͵ļ��g��ȫ���P�I������ʲô5

1.2.2�����Z��ģ�͵ıO���c��Ҏ�����R��Щ�P�I���}6

1.3������ʽ�˹����ܰ�ȫ����Ҫ��6

1.3.1���������Z��ģ�͵�������κ��u7

1.3.2�����ʹ��Z��ģ�͵ķ����L�U9

1.3.3�����o���Z��ģ�͵��Ñ������[˽9

1.3.4�����ϴ��Z��ģ�ͷ��յ��B�m��10

1.3.5����ߴ��Z��ģ�͵�ϵ�y������11

1.4�����Z��ģ�Ͱ�ȫ�ĬF���c����11

1.4.1�����Z��ģ�͵İ�ȫ�[���c��Ҫ�L�U�c12

1.4.2�����Z��ģ���c���Ұ�ȫ�L�U14

1.4.3�����Z��ģ�Ͱ�ȫ����֮�����lչ�c��ȫ����15

��2�¡����Z��ģ�ͼ��g����İ�ȫ�L�U17

2.1�����Z��ģ�͵���Ϣ��ȫԭ�t18

2.1.1���C����18

2.1.2��������18

2.1.3��������18

2.2�����y��ȫ�L�U19

2.2.1�����y�W�j������Ȼ��������20

2.2.2����Ҋ�Ă��y�W�j������ʽ21

2.3���R�e�ͷ��������D�ϵ�����21

2.3.1��������D���R�e�y�}22

2.3.2��AI����̓����Ϣ����23

2.3.3������AI�M�кڿ���24

2.4�����Z��ģ�͵Ĺ��д�����24

2.4.1����������25

2.4.2�����T����29

2.4.3��Prompt����30

2.4.4������Ͷ������31

2.4.5��ģ�`ȡ����32

2.4.6�������`ȡ����33

2.4.7��������Ҋ��ȫ�L�U34

��3�¡����Z��ģ�ͱO���c��Ҏ�ķ��ɿ��37

3.1��ȫ��ҕҰ�µ�AIGC�O�ܬF��38

3.1.1��AIGC��I���R���V�A����38

3.1.2��ᘌ�AIGC��I�Ĉ̷��{���Ҋ���r41

3.1.3������ץ�oAIGC���P����44

3.2�����ȵıO���wϵ45

3.2.1�����ȱO���wϵ����45

3.2.2�����ȬF�бO�����������c���Y48

3.2.3���������c�O�����߽��x50

3.3������ĵ��ͷ���54

3.3.1���W��54

3.3.2������68

3.3.3��Ӣ��73

3.3.4���¼���75

3.3.5�����ô�77

3.3.6���n��78

��4�¡����Z��ģ��֪�R�a���Ҏ81

4.1��������82

4.1.1�����������82

4.1.2��AIGC������������ඨ�Է���82

4.1.3��AIGC���g���P���������֙��L�U85

4.1.4�����Ͱ�������88

4.1.5���Y99

4.2���_Դ�f�h103

4.2.1���_Դ�f�h����103

4.2.2���_Դ�f�h���l���֙��L�U106

4.2.3���漰�_Դ�f�h�����P����107

4.2.4���漰�_Դ�f�h���֙��L�U������ʩ109

4.3��������109

4.3.1�����������109

4.3.2��AIGC�����µČ��������P���}110

4.4���̘˙�112

4.4.1���̘˙����112

4.4.2��AIGC�����µ��̘��֙�113

4.4.3���˹������������c�̘��֙�113

4.5���̘I����115

4.5.1���̘I���ܸ���115

4.5.2��AIGC�����³�Ҋ���̘I�������P�L�U116

4.5.3�����Ͱ�������118

4.5.4���Y120

��5�¡����Z��ģ�͔�����Ҏ123

5.1��ģ��Ӗ���A��124

5.1.1�������ɼ�124

5.1.2�������|������134

5.2��ģ�͑����A��137

5.2.1����֪ͬ��138

5.2.2��������Ϣ������ʹ138

5.2.3���ռ���ͯ������Ϣ139

5.2.4�������羳139

5.3��ģ�̓����A��142

5.3.1������ʹ��142

5.3.2��������ȫ143

��6�¡����Z��ģ�̓��ݰ�ȫ145

6.1�����ݰ�ȫ�O��146

6.1.1������ҕ���µıO��146

6.1.2������ҕ���µıO��147

6.2�����ݰ�ȫ�L�U149

6.2.1������������������֙�؟��149

6.2.2���O�ܙC�����������̎�P150

6.2.3������̎�P150

6.3�����ݰ�ȫ��Ҏ151

6.3.1��ģ��Ӗ���A��151

6.3.2��ģ�͑����A��155

6.3.3��ģ�̓����A��160

��7�¡����Z��ģ���㷨��Ҏ163

7.1���㷨��Ҏ��ܸ���164

7.2���㷨�䰸164

7.2.1��������������ʩ�śr164

7.2.2���䰸����166

7.2.3���㷨�䰸��ڼ���ɫ167

7.2.4���䰸����ʂ���ļ�������168

7.2.5���䰸����168

7.3���˹����ܰ�ȫ�u��169

7.4���㷨���_��170

7.5���㷨���Ƀ��ݘ��R173

7.6���㷨����ҕ176

7.6.1���㷨�OӋ178

7.6.2��Ӗ�������x��179

7.6.3��ģ�����ɺ̓���180

7.7���c�㷨���P���֙�181

7.8���㷨��ҎҪ�c���Y185 ��8�¡����Z��ģ�͂�����ȫ187 8.1�����Z��ģ�͂�����AI���g�M���ĵ��¾S��188 8.1.1�������������l��AI������˼��188 8.1.2���˹����܂���������һ�����s�Һ��w�����h�}191 8.2���˹����܂�������Ҫ��191 8.2.1�������������Σ����Z��ģ�͂���Ҏ�������Ӱ�192 8.2.2���_����Ҏ�ԣ���I�ͽM��������Ҏ���ı�Ҫ��192 8.2.3������ɳ��m��δ��������Ҏ�����L�����Ӱ�193 8.3�����Z��ģ�͂�����ȫ�L�U���������194 8.3.1����Ҫ�Ă����L�U194 8.3.2�������L�U�ij���195 8.4���҇��˹����܂������팍�`195 8.4.1���҇��˹����܂������P��Ҏ���߸���196 8.4.2���_���Ƽ����������w�ƙC��198 8.5�����Z��ģ�͂����L�U��������205 8.5.1���о��_�l�ߵ�؟��205 8.5.2���OӋ�����ߵ�؟��206 8.5.3���������ߵ�؟��207 8.5.4���Ñ���؟��208 ��9�¡����Z��ģ�͵İ�ȫ���Ϸ���211 9.1�����y���g����İ�ȫ����212 9.1.1�����Z��ģ����ϵ�y����İ�ȫ����212 9.1.2�����Z��ģ���пɑ��õĽ��䰲ȫ���g214 9.1.3�����Â��y��ȫ���`�Ľ��215 9.2����������ı��ϲ���217 9.2.1�������ռ��A�����R�İ�ȫ����218 9.2.2��Ӗ���A�εİ�ȫ���h219 9.2.3��ģ�������A�εİ�ȫ���h220 9.3�����Ō��ԽǶȵİ�ȫ���o����221 9.3.1�����Z��ģ�Ϳ����ε�֧��222 9.3.2����O�ܺͱO��223 9.3.3�����g�����ԺͰ�ȫ��223 9.3.4���[˽�͔�������224 9.3.5������226 9.3.6�������Ժ�ƽ��228 9.3.7������ͭh��׃��229 9.3.8����؟�C��231 ��10�¡�����ʽ�˹�����δ��չ��233 10.1�����gҕ�ǿ����Z��ģ�Ͱ�ȫ�İlչڅ��234 10.1.1��������ȫ���c�ɿ���234 10.1.2����������c�ɽ����235 10.1.3�����������cЧ��236 10.1.4��������Ȃ��켼�g237 10.1.5���^�K朼��g�ļ���238 10.2������ҕ�ǿ����Z��ģ�Ͱ�ȫ�İlչڅ��239 10.2.1��ȫ�����o���ɷ�Ҏ�ڴ�ģ���I��ļ����c����240 10.2.2��ȫ�����㷨�O�ܿ�ܵ���u����241 10.2.3��AI�r����֪�R�a��244 10.2.4������Ҏ���ķ��ɻ�251

��ģ�Ͱ�ȫ���O���c��Ҏ ���ߺ���

���ߺ���

���t��

�Ϻ���ͨ��W���ɴTʿ����؟�Ƽ����Ϻ�����ʼ�˼�CEO��������ȫ�c������Ϣ���o��֪����ƽ�_“��Ҏ��”�����ˣ�������Ҏ֪�R��^������ǰ�����ھ����±����WԺԺ�L��֪����ԃ��˾��ϯ���ݹ١����Ї��ҷ����I�Y������ȫ�u������DSA����������ȫ���̎���������Leading SAFe��MCE���J�C��

�mо���Ƿ��ɷ��ՈF�

ԓ�F����Ϻ��m���Ɏ���������ɫ���ɷ��ՈFꠣ��ɆT�߂�Ӌ��C�ͷ��ɵȌ��I��������I���������p��ҕ�ǡ��F꠳ɆT���m�o�^����I�ṩ���|���գ����ͷ��ɷ��հ�������Ҫ����ͨ��Ҏ��AIGC��Ҏ���պ���I����������Ҏ�ȡ��F꠳ɆT�����x�����硶��Ʒ���ɷ���Ʒ��ָ�ϣ�2024����������Ҏ�I���Ɏ���䛡����ߺ���

���t��

�Ϻ���ͨ��W���ɴTʿ����؟�Ƽ����Ϻ�����ʼ�˼�CEO��������ȫ�c������Ϣ���o��֪����ƽ�_“��Ҏ��”�����ˣ�������Ҏ֪�R��^������ǰ�����ھ����±����WԺԺ�L��֪����ԃ��˾��ϯ���ݹ١����Ї��ҷ����I�Y������ȫ�u������DSA����������ȫ���̎���������Leading SAFe��MCE���J�C��

�mо���Ƿ��ɷ��ՈF�

ԓ�F����Ϻ��m���Ɏ���������ɫ���ɷ��ՈFꠣ��ɆT�߂�Ӌ��C�ͷ��ɵȌ��I��������I���������p��ҕ�ǡ��F꠳ɆT���m�o�^����I�ṩ���|���գ����ͷ��ɷ��հ�������Ҫ����ͨ��Ҏ��AIGC��Ҏ���պ���I����������Ҏ�ȡ��F꠳ɆT�����x�����硶��Ʒ���ɷ���Ʒ��ָ�ϣ�2024����������Ҏ�I���Ɏ���䛡�

���W���Ɏ����m�������������Ρ����ϻ��ˣ��A�|������WУ�⌧�����Ϻ��Ʌf���ֿƼ��c�˹����܌��Iί�T��ί�T��������“2024Ʒ��֮�ǣ������Ɏ�”��

�~���Ɏ����m���������I�����Oί�T��ί�T���A�|������W���WԺУ�⌧�����Ї��W�j��ȫ���鼼�g�c�J�C������Ӗ������

ꐉ�@�Ɏ��ǔ�����Ҏ�I���Y���Ɏ����I��IoT��I��ƸDPO���Ϻ��Ʌf������Ҏ���Iί�T��ί�T��������“2024Ʒ��֮�ǣ����J�Ɏ�”��

���ŝ��Ɏ��߂���ⷨ�W���������c�������ⷨ�ɷ��ս�����ͨ�^���H��ҕҰ����I�ṩ�������┵����Ҏ���ɷ��ա�

������

ܛ���½������ң�MIEE����ܛAzure AI���̎������������YԴ��������Ͼ���쌣�ҡ��Ϻ���ͨ��W��ƸAIGC�v��������Y��AI����Ͷ�Y���MaxFuture AI��ʼ�ˡ����ýCEO�����̘I�zӰ�����ݺ���Ƭ�I��ҫ@��s�������S����ҕ�XӰ���������{���Ԫ���Č��I�����͌��`�������ڞ���I�͙C���ṩǰ�ص�AIGC��Ӗ���̘I���ա�

ꐌW�M

�Y��ܘ�����AI���g���ҡ�������ڇ�����Ӎ���Ϻ���������˾��ŘI�շ��ղ������μܘ������գ�����ּ���ƽ���Ƽ��������Ƽ��ͺ�����ӵȽ��ڿƼ���˾�����»���AI�ʹ��Ĕ��ֻ��I�Nϵ�y�ļܘ��OӋ�ͼ��g������������ȅ��c�^AI��AIGC���P���Ŀ�аl�����ã���AI��AIGC���P�Ĺ��̻����I�Ց������^����о���

- >

������x�c�ղء������ČW����:һ��Ĺ���

- >

���������~����Փ/���С��

- >

���Ҏ����x��Ѹ:����Ϧʰ

- >

�_ӹ���������n�

- >

ɽ����

- >

����

- >

�����b�L�������o���ӵ��Ї���Ԓ

- >

С�����Ĺ���-���b��3��

![�]�������đ������P����؛���c�Q��](http://image31.bookschina.com/pro-images/250513gs/487100.jpg?id=81)